1. 概述

本文将介绍同步定位与建图(SLAM)的基本概念及其重要性。这是一个跨领域的技术方向,涉及计算机视觉、传感器等多个研究领域,广泛应用于自动驾驶、机器人导航等场景。我们还将简要说明其工作原理以及实现SLAM的常见技术手段。

2. SLAM简介

SLAM(Simultaneous Localization and Mapping)即“同步定位与建图”,指的是在未知环境中,机器人在构建地图的同时,也能确定自身位置的过程。

这是移动机器人在未知或部分未知环境中运行的关键技术之一。通过SLAM算法,机器人可以绘制出环境地图,为后续任务如避障、路径规划等提供基础数据。

SLAM的研究始于上世纪90年代初。当时人们认为,机器人在未知环境中既要建图又要定位,几乎不可能实现,因此被称为“鸡生蛋还是蛋生鸡”的问题(Chicken-Egg Problem)。但如今,已有多种近似解法可以有效应对这一挑战。

需要注意的是,SLAM并不是单一的技术或系统,而是一个广义的概念,具有无限的变体和实现方式。它既可以用于扫地机器人,也可以用于自动驾驶汽车,具体实现取决于环境、使用场景以及所采用的传感器和算法。

3. 为什么需要SLAM?

随着计算能力的提升以及低成本传感器(如摄像头、激光测距仪)的普及,SLAM在多个领域的应用变得更加实际。

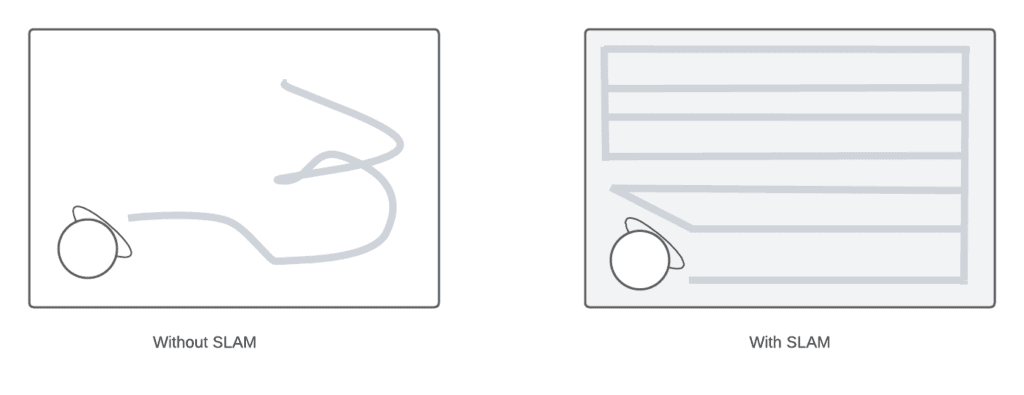

以扫地机器人为例:在选购前,我们常常会看到一些产品评论指出,某些机器人无法有效绘制环境地图,导致清洁效率低下。这时候SLAM和LiDAR就显得尤为重要。不同型号的扫地机器人之间性能差异,往往就体现在其搭载的SLAM技术和传感器质量上。

没有SLAM支持的机器人难以完成环境建图和自身定位,清洁任务也可能因此失败。当然,其他传感器和摄像头在定位和建图中也扮演着重要角色。

下图展示了有SLAM和无SLAM的机器人在环境建图方面的明显差异:

此外,SLAM还广泛应用于仓库中的机器人导航、自动驾驶汽车的自动泊车、未知环境中的机器人配送等场景。在实际应用中,SLAM还可以与目标跟踪、路径规划等技术结合使用,提升整体系统的智能化水平。

4. SLAM的工作原理

4.1. 前端与后端

SLAM通常可以分为前端和后端两部分:

- 前端:主要负责从传感器(如摄像头、距离传感器、LiDAR)中获取原始数据,并进行特征提取和初步处理。

- 后端:负责优化机器人位姿(pose)和地图信息,通常涉及图优化(graph-based optimization)或滤波方法(如卡尔曼滤波、粒子滤波)。

4.2. 视觉SLAM(vSLAM)

视觉SLAM(Visual SLAM,简称vSLAM)主要依赖摄像头(如普通摄像头、RGB-D摄像头、复眼摄像头)采集图像数据。由于摄像头成本较低,vSLAM可以在成本受限的项目中实现。

摄像头不仅能捕捉大量信息,还便于识别地标(landmark),配合图优化技术,可以实现灵活的SLAM系统。

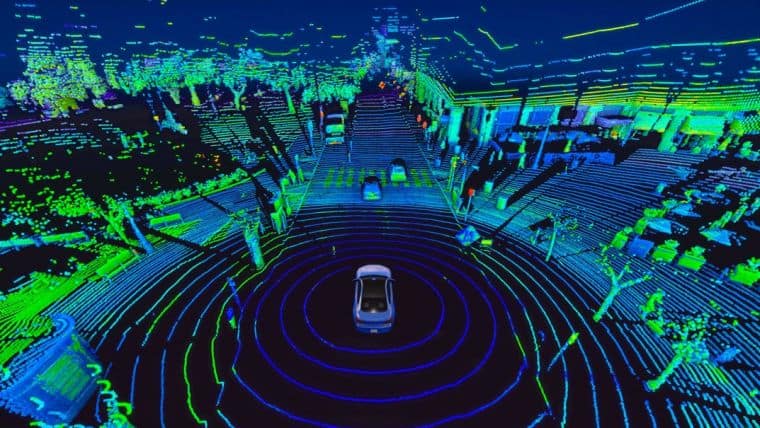

下图展示了一个由JdeRobot开源组织生成的vSLAM三维点云地图示例:

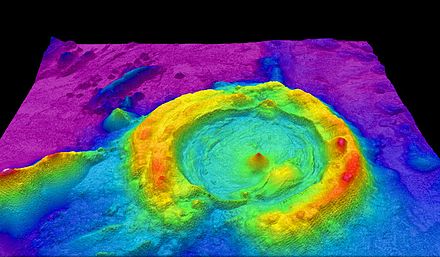

4.3. LiDAR SLAM

LiDAR(Light Detection and Ranging)是一种利用激光或距离传感器进行测距的技术。相比摄像头,LiDAR在精度上更胜一筹。例如,带有LiDAR的扫地机器人通常能构建更精确的地图。

LiDAR传感器通常输出二维或三维点云数据。SLAM系统通过逐帧匹配点云数据来估算机器人运动轨迹,并据此实现定位。

常见的点云匹配算法包括:

- 迭代最近点算法(Iterative Closest Point, ICP)

- 鲁棒点匹配算法(Robust Point Matching)

之后,研究人员通常使用栅格地图(grid map)或体素地图(voxel map)来表示点云地图。

下图展示了一个搭载LiDAR传感器的无人机所生成的三维点云地图示例:

5. 总结

本文介绍了SLAM的基本概念、应用场景及其工作原理。✅

SLAM技术广泛应用于扫地机器人、自动驾驶汽车、无人机、医疗设备等多个领域。 随着传感器成本的下降和计算能力的提升,SLAM的实用性和普及率将持续增长。

SLAM的实现方式多样,主要包括视觉SLAM和LiDAR SLAM,它们各有优劣,适用于不同场景。在实际开发中,往往需要结合多种传感器和算法来优化系统性能。

踩坑提示:

- ❌ 不要轻视传感器数据的噪声问题,SLAM系统必须具备良好的滤波和误差修正机制。

- ⚠️ 视觉SLAM在低光或纹理缺失环境中表现较差,需考虑多传感器融合方案。

未来,SLAM技术将继续在智能机器人、增强现实、无人机等领域发挥重要作用。