1. 概述

在使用机器学习的过程中,我们常常会通过一些指标来衡量模型的表现。其中 Loss(损失) 和 Accuracy(准确率) 是两个非常关键的指标。

不过,很多人对这两个指标的含义、计算方式和实际意义存在误解。理解它们可以帮助我们更好地分析模型的训练过程和性能表现。

本篇文章将重点解析这两个指标的含义、区别以及如何通过它们来判断模型是否在正常学习。

2. Loss 是什么?

Loss 是模型预测值与真实值之间误差的度量,是训练过程中模型不断优化的目标函数。

- Loss 值越高,说明模型预测越不准

- Loss 值越低,说明模型越接近真实结果

Loss 通常通过一个叫做 损失函数(loss function) 的数学公式来计算。常见的损失函数有:

- 分类任务:交叉熵损失函数(Cross-Entropy Loss)

- 回归任务:均方误差(Mean Squared Error, MSE)

举个例子:

假设我们要预测一个像素点的颜色值,范围是 0~255,使用 MSE 作为损失函数:

- 若 Loss 为 1,则误差非常小,模型表现很好

- 若 Loss 为 100,则误差很大,模型预测值偏离真实值较远

2.1 Loss 的变化趋势更重要

虽然 Loss 的绝对值有参考意义,但更重要的是 它在训练过程中的变化趋势。

- Loss 持续下降 → 模型正在学习

- Loss 波动无下降趋势 → 模型可能没有学到任何东西

- 训练集 Loss 下降,验证集 Loss 不下降或上升 → 模型可能过拟合

在这种情况下,建议:

✅ 增加正则化

✅ 使用更简单的模型

✅ 调整学习率(尤其在深度学习中)

3. Accuracy 是什么?

Accuracy 是分类任务中最直观的指标之一,表示模型预测正确的样本占总样本的比例。

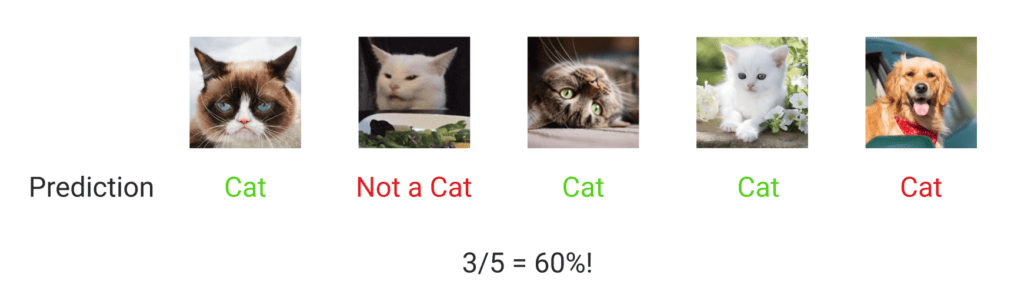

比如,我们训练一个图像分类模型来识别图片中是否有猫,测试集有 5 张图片:

- 模型正确识别出 3 张 → Accuracy = 60%

Accuracy 虽然直观,但它有局限性,在类别不平衡时容易误导。例如,一个数据集中 99% 是负样本,模型全预测为负,也能得到 99% 的 Accuracy,但其实模型没有学习到任何有用信息。

4. Loss 与 Accuracy 的关系

虽然 Loss 和 Accuracy 都是评估模型的指标,但它们从不同角度反映模型的表现。我们可以通过组合这两个指标来更全面地分析模型状态。

| Accuracy ↓ → Loss ↓ | 高 Accuracy | 低 Accuracy |

|---|---|---|

| 高 Loss | 很少出现 | 模型在部分样本上犯了大错 |

| 低 Loss | 理想状态 | 模型在大多数样本上都犯了小错 |

4.1 几种典型情况分析

- ✅ 高 Accuracy + 低 Loss:理想状态,模型预测准确,误差小

- ❌ 低 Accuracy + 高 Loss:模型预测错误多,且错误严重

- ⚠️ 高 Accuracy + 高 Loss:模型在少数样本上犯了大错,但整体预测正确(可能样本不平衡)

- ⚠️ 低 Accuracy + 低 Loss:模型整体预测错误,但每个错误都比较轻微

5. 总结

- Loss 是模型优化的目标函数,反映预测误差的大小

- Accuracy 是分类任务中衡量预测正确率的指标,但不适用于类别不平衡场景

- 两者结合可以更全面地判断模型是否在学习、是否过拟合等

- 观察 Loss 曲线比看最终 Loss 值更有意义

- 在训练过程中,建议同时监控训练集和验证集的 Loss 与 Accuracy

✅ 踩坑提醒:不要只看 Accuracy,尤其是在类别不平衡时;不要只看 Loss 的绝对值,要看趋势。

如果你对模型训练曲线感兴趣,推荐阅读我们的 Learning Curves 解析文章。