1. 引言

本文将简要介绍神经网络的基本概念及其常见类型,然后重点讲解 Epoch、Iteration 和 Batch Size 之间的区别。

这些术语在深度学习中非常常见,但对初学者来说容易混淆。即使是经验丰富的开发者,也可能会在训练模型时踩坑。希望本文能帮你理清思路,避免在训练模型时出现误解。

2. 什么是神经网络?

2.1. 定义

神经网络是一组算法的组合,用于识别输入数据中的潜在模式。它通过分层处理数据,提取特征,最终完成预测或分类任务。

举个例子,我们有一组猫狗图片,希望训练一个模型能自动识别新图片是猫还是狗。这个过程类似于教小孩识别猫狗,本质上是一个分类问题。

神经网络是深度学习的核心组成部分。深度学习(Deep Learning)是一个更学术化的术语,用来描述这种数据驱动的学习方式。

常见的应用场景包括:

- 图像识别

- 自然语言处理(NLP)

- 语音识别

- 自动驾驶

- 机器人控制

2.2. 结构

神经网络由多个层(Layer)组成,每层包含多个节点(Node),每个节点负责执行计算。

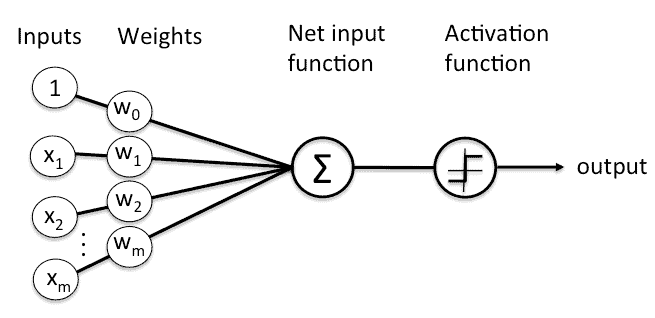

一个节点接收输入向量和对应的权重,经过函数处理后输出到下一层。如下图所示是一个典型的感知机节点:

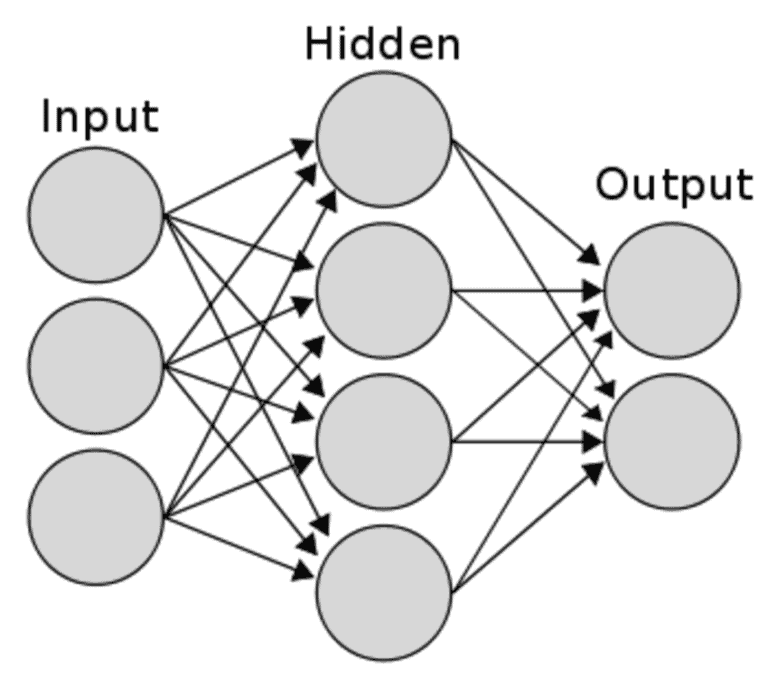

一个基本的神经网络通常由三部分组成:

- 输入层(Input Layer):接收原始数据

- 隐藏层(Hidden Layer):负责特征提取与转换

- 输出层(Output Layer):输出最终预测结果

下面是一个典型的两层神经网络结构图(输入层不计入层数):

2.3. 类型

根据数据流动方式、学习机制和记忆能力,神经网络可以分为多种类型,常见的包括:

- 前馈神经网络(Feed Forward Network)

- 循环神经网络(Recurrent Neural Network, RNN)

- 长短期记忆网络(Long Short-Term Memory, LSTM)

- 卷积神经网络(Convolutional Neural Network, CNN)

每种类型适用于不同的任务场景,选择合适的网络结构对模型性能至关重要。

3. 神经网络中的基础术语

理解以下术语对于训练神经网络至关重要:

3.1. Epoch

✅ Epoch 是指整个训练集被完整训练一次的过程。

比如,训练集中有 10 万张图片,一个 Epoch 表示模型完整地学习了这 10 万张图片一次。

⚠️ 注意:增加 Epoch 数量不一定能提高模型性能,训练过多可能导致过拟合。

3.2. Iteration

✅ Iteration 是指一个 Batch 数据训练一次的过程。

一个 Epoch 会包含多个 Iteration。Iteration 的数量 = 数据总量 / Batch Size。

3.3. Batch Size

✅ Batch Size 是指每次训练所使用的样本数量。

Batch Size 越大,训练速度越快,但对内存要求也越高。通常需要根据 GPU 显存大小进行调整。

4. 举例说明它们之间的关系

我们以“猫狗分类”为例:

- 假设训练集有 100 万张图片

- 设置 Batch Size = 50,000

那么:

- 每个 Epoch 需要 20 次 Iteration(1,000,000 ÷ 50,000 = 20)

- 每次 Iteration 处理 5 万张图片

- 如果训练 10 个 Epoch,则总共进行了 200 次 Iteration

📌 总结一句话:

一个 Epoch = 所有训练数据过一遍

一个 Iteration = 一个 Batch 的训练过程

Batch Size = 每次训练使用的样本数

5. 总结

本文介绍了神经网络的基本结构、常见类型,并重点讲解了 Epoch、Iteration 和 Batch Size 三个关键术语的区别。

理解这些术语有助于:

- 更好地设置训练参数

- 合理评估模型训练进度

- 避免在调参时踩坑

掌握这些基础概念,是深入学习深度学习模型的第一步。如果你是刚入门的开发者,建议从简单的分类任务入手,逐步理解训练流程和参数设置。