1. 概述

在本篇文章中,我将介绍几种常见的目标识别任务(Object Recognition Tasks)的基本定义,并详细说明它们之间的主要区别。同时,我会列出目前用于解决这些计算机视觉任务的主流深度学习模型。

目标识别是计算机视觉领域中的核心任务之一。虽然它们之间有联系,但每种任务的目标和输出形式都有所不同。理解这些差异对于选择合适的模型和方法至关重要。

2. 什么是目标识别?

目标识别是一个广义术语,指的是在数字图像中识别目标对象的一系列计算机视觉任务。这些任务包括但不限于:

- 图像分类(Image Classification)

- 目标定位(Object Localization)

- 目标检测(Object Detection)

- 语义分割(Semantic Segmentation)

- 实例分割(Instance Segmentation)

目前,深度学习(尤其是卷积神经网络 CNN)是执行目标识别任务最有效的方法。

3. 各类目标识别任务详解

下面我们将逐一介绍这些任务的具体内容、输出形式以及常用模型。

3.1. 图像分类(Image Classification)

图像分类的任务是为整张图像分配一个类别标签。即使图像中包含多个对象,模型也只会输出一个最终的类别标签。

✅ 输入:一张图像

❌ 输出:一个类别标签(如 "厨房"、"卧室")

示例:给定一张包含客厅的图像,图像分类模型会输出标签 "客厅"。

常用的图像分类模型包括:

- AlexNet

- VGG-16

- Inception-v3

- Xception

- EfficientNet

这些模型都基于卷积神经网络(CNN),在 ImageNet 等数据集上表现优异。

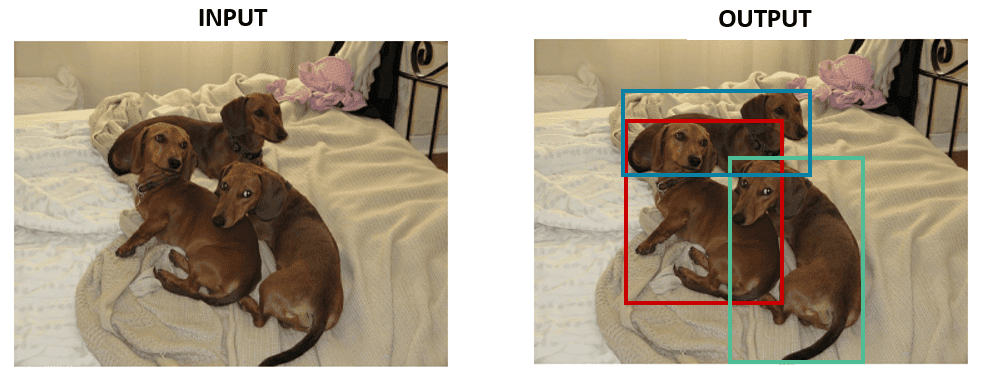

3.2. 目标定位(Object Localization)

目标定位的任务是检测图像中某个目标的位置,并用边界框(bounding box)表示。但 不进行分类,只输出目标位置。

✅ 输入:一张图像

❌ 输出:一个或多个边界框(bounding box)

边界框通常由中心点坐标(或左上角坐标)、宽度和高度定义。

⚠️ 踩坑提示:目标定位一般只用于单一对象的场景。如果你需要识别多个对象并标注类别,应该使用目标检测。

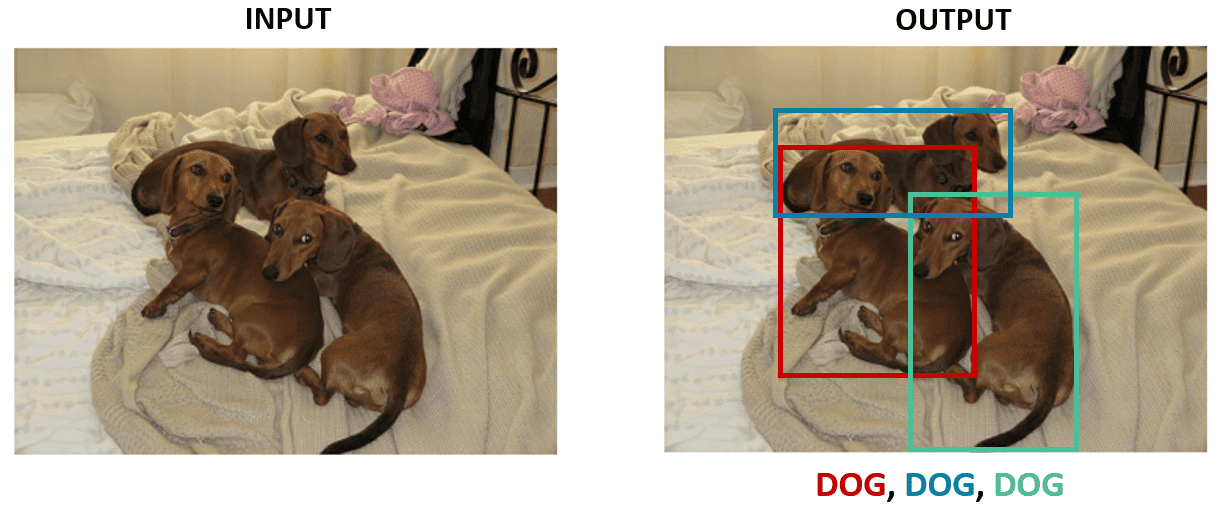

3.3. 目标检测(Object Detection)

目标检测是目标定位和图像分类的结合体。它不仅要检测出图像中所有目标的位置(边界框),还要为每个目标分配一个类别标签。

✅ 输入:一张图像

✅ 输出:多个边界框 + 对应的类别标签

这是目前应用最广泛的目标识别任务之一,适用于自动驾驶、视频监控、智能安防等场景。

常用的目标检测模型包括:

- Faster R-CNN

- YOLO 系列(如 YOLOv5、YOLOv8)

- SSD(Single Shot Detector)

- EfficientDet

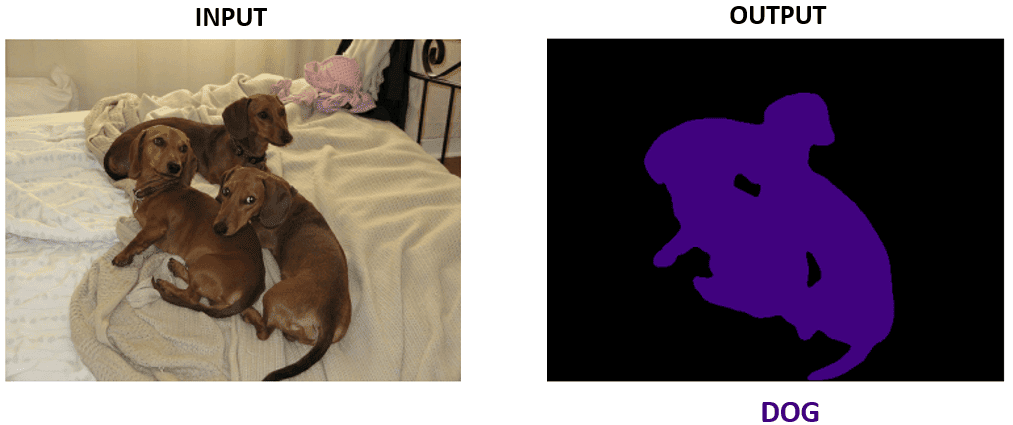

3.4. 语义分割(Semantic Segmentation)

语义分割的任务是为图像中的每一个像素分配一个类别标签。与目标检测不同的是,它关注的是“哪些像素属于哪一类”,而不是“哪个对象是哪一个”。

⚠️ 注意:语义分割无法区分同一类别的多个实例。例如,图像中有两只狗,语义分割会把它们合并为一个“狗”的区域。

✅ 输入:一张图像

✅ 输出:每个像素的类别标签

常用模型:

- FCN(Fully Convolutional Network)

- U-Net

- DeepLab 系列(如 DeepLabv3+)

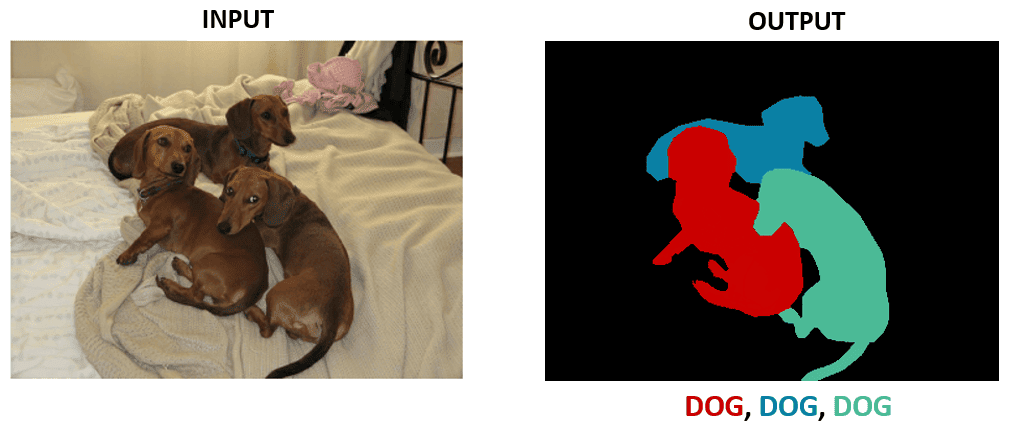

3.5. 实例分割(Instance Segmentation)

实例分割可以看作是语义分割的升级版。它不仅为每个像素分配类别标签,还能区分属于同一类别的不同对象。

✅ 输入:一张图像

✅ 输出:每个像素的类别标签 + 每个对象的独立掩码(mask)

例如,图像中有两只狗,实例分割会分别为它们生成两个独立的“狗”区域。

常用模型:

- Mask R-CNN

- MaskLab

- TensorMask

4. 总结

本文系统梳理了目标识别领域中的五大核心任务:图像分类、目标定位、目标检测、语义分割和实例分割。每种任务的输入输出形式和应用场景都有所不同,因此在实际项目中选择合适的方法至关重要。

| 任务名称 | 输出形式 | 是否分类 | 是否定位 | 是否像素级 |

|---|---|---|---|---|

| 图像分类 | 类别标签 | ✅ | ❌ | ❌ |

| 目标定位 | 边界框 | ❌ | ✅ | ❌ |

| 目标检测 | 边界框 + 标签 | ✅ | ✅ | ❌ |

| 语义分割 | 像素标签 | ✅ | ❌ | ✅ |

| 实例分割 | 像素标签 + 实例掩码 | ✅ | ✅ | ✅ |

希望这篇文章能帮助你更清晰地理解目标识别任务之间的差异,并为你的项目选型提供参考。